Quel étrange lien unit science et fiction ? Nous aimerions aborder cette question sous un angle bien précis : non pas celui de l’influence des œuvres de fiction sur le travail scientifique, comme influence culturelle, ni la relation inverse, c’est-à-dire l’influence de la science, des théories et découvertes scientifiques sur les œuvres de fiction. Nous nous intéresserons ici au rôle du dispositif fictionneldans la science. Nous aimerions comprendre ce que viennent faire les élaborations qui relèvent de la fiction, du récit non véridique, contrefactuel, au sein même d’un article scientifique ou d’un propos scientifique. Partant d’un exemple précis, celui de l’expérience de pensée que propose le mathématicien britannique Alan Turing dans son célèbre article « Computing Machinery and Intelligence », publié dans la revue Mind en 1950, nous analyserons le contenu et la portée que donne le scientifique à cette histoire qu’il nous raconte, parce qu’il s’agit bien, nous le verrons, d’une histoire avec des personnages, un décor, une intrigue. Nous essaierons de montrer la puissance de la fiction qu’il élabore et de révéler son ambiguïté fondamentale. Il semble que le but de cette fiction soit d’explorer ce qui peut résulter d’une expérience scientifique donnée si nous avions les moyens de la réaliser. Mais comme nous allons le voir, c’est précisément cette fiction qui va nous permettre de mettre en place, de donner sens, de développer les moyens techniques qui nous manquaient pour la réaliser. Afin de mieux dégager les tenants et aboutissants de l’imitation game de Turing, nous commencerons par recontextualiser son article en exposant les principes du champ scientifique dans lequel il émerge : la cybernétique.

La cybernétique est une science qui est née dans les années 1940 et qui a disparu de façon brutale au milieu des années 1950. C’est donc une science « morte », comme on pourrait le dire d’une langue qui n’est plus parlée. Mais voilà justement tout le paradoxe de la cybernétique, la langue que nous parlons aujourd’hui, elle l’a inventée ; nous parlons cybernétique. Qu’est-ce que cela veut dire ? Nous disons : « le système nerveux d’un mollusque transmet l’information suivant un code, l’analyse puis la traite » (Changeux, 212), nous nous qualifions de « société de communication », nous faisons des réunions de feedback pour corriger les process en cours et surtout nous vivons avec, parmi, dans nos machines, nos ordinateurs, nos réseaux : « Nous vivons dans un monde cybernétique, mais sans cybernétique » (Triclot, 9). Nous n’analyserons pas ici les raisons du succès et de l’échec de la science cybernétique (voir à ce sujet Hayles et Triclot), nous nous concentrerons sur les glissements de sens qui s’opèrent dans la définition de l’humain pendant ce que Mathieu Triclot appelle le « moment cybernétique ».

Partons de la définition que donne Norbert Wiener (1884-1964), mathématicien américain fondateur de cette nouvelle science (Wiener, 1948) : la cybernétique est la science du contrôle et de la communication dans les machines et les animaux. S’il fallait assigner un point de départ à cette science, ce serait la publication de deux articles fondateurs en 1943 : « Behavior, Purpose and Teleology» de Arturo Rosentblueth, Norbert Wiener et Julian Bigelow ; et « A Logical Calculus of the Ideas Immanent in Nervous Activity» de Warren McCulloch et Walter Pitts.

Le premier article a pour ambition de décrire les machines et le vivant en termes purement mécanistes. Les objets du monde peuvent être divisés en deux catégories, ceux dont le comportement vise un but et ceux dont le but est donné de l’extérieur. Il n’y a plus de différence entre vivant et inerte, c’est le fait qu’un système soit autorégulé ou non qui permettra de le catégoriser. De ce point de vue, les machines cybernétiques qui reposent sur le traitement de l’information et la régulation de leur comportement en fonction des données recueillies, sont de même nature que les êtres vivants.

L’article du neurophysiologiste Warren McCulloch et du logicien Walter Pitts propose quant à lui un modèle logique pour décrire le fonctionnement du cerveau. Les deux scientifiques s’inscrivent dans une perspective fortement béhavioriste et cherchent à expliciter la manière dont le cerveau coderait le comportement humain. Leur théorie, dite des neurones artificiels, cherche à réassigner la logique dans une dimension physiologique. Ils proposent un modèle simplifié du cerveau humain.

Ces deux événements vont marquer un tournant et donner son point de départ à l’aventure cybernétique. La question qui va nous intéresser ici est celle des transformations profondes que le programme cybernétique a opérées dans le domaine scientifique, et plus largement dans l’acception commune, dans sa manière notamment de catégoriser les êtres. La cybernétique brouille les frontières entre vivant et inerte. Elle introduit une nouvelle façon de voir les êtres qui ne fait plus une différence fondamentale, incommensurable entre êtres vivants et non vivants. À partir de l’avènement de la cybernétique, nous voyons se développer de nouveaux usages du langage : les scientifiques se mettent à parler d’intelligence concernant des machines, ils utilisent la même expression de « traitement de l’information » indifféremment pour les opérations qu’effectuent un cerveau ou un ordinateur. Un parallèle puissant va se mettre en place entre le cerveau et l’ordinateur. C’est ce déplacement qui nous intéresse. Il paraît légitime de se demander comment, nous, êtres humains, qui n’avons jamais expérimenté la pensée en dehors d’un corps, en sommes venus à croire que la pensée n’était pas forcément l’oeuvre d’un corps vivant ? Comment s’est effectuée cette séparation entre la pensée et le corps de chair, cet arrachement de la pensée à sa chair qui rend possible une question qui aurait sûrement paru saugrenue à un Aristote : « Les machines peuvent-elles penser ? ». C’est précisément la question que pose Alan Turing dans son article « Computing Machinery and Intelligence ».

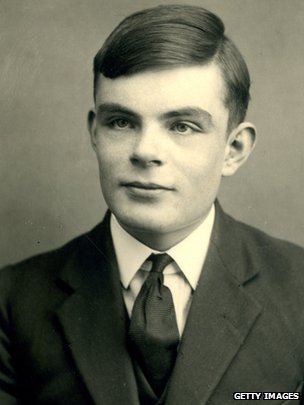

Quel est le rôle de Turing dans le champ de la cybernétique ? Ce mathématicien, cryptologue et informaticien britannique, a l’étoffe d’un véritable personnage de film. Il est le fondateur de l’informatique, il a réussi à déchiffrer les messages de la fameuse machine Enigma utilisée par l’armée nazie pendant la Seconde Guerre mondiale et il a connu une fin aussi tragique que cinématographique (voir l’importante biographie que lui consacre Andrew Hodges). Ses idées et son travail sont très proches de ceux du club des cybernéticiens mais Turing est indépendant et solitaire. Il n’a jamais assisté à une conférence Macy (le grand rassemblement du club des cybernéticiens entre 1942 et 1956) et a eu très peu de contacts avec ceux qui partagent ses préoccupations : il travaille pourtant à Princeton avec von Neumann de 1936 à 1939, mais lorsque celui-ci lui propose de devenir son assistant, il décline l’offre pour retourner à Cambridge (Lassègue, 29). Ses écrits mathématiques sont très importants pour la cybernétique parce qu’ils forment la matrice qui a engendré l’architecture logique de l’ordinateur telle que la présente formellement pour la première fois John Von Neumann, le père du premier ordinateur, dans un article de 1945, « First Draft of a Report on the EDVAC». Avant cet article, il n’y avait que des calculateurs, de grosses machines capables de faire des calculs compliqués. Après cet article, il y a des ordinateurs capables d’effectuer diverses tâches (stocker des informations, exécuter des instructions, vérifier l’exécution des instructions). La différence est essentielle : elle autorise des fusions, des déplacements, des glissements de sens qui font insensiblement passer du calcul au traitement de l’information, du calculateur à l’ordinateur, de la pensée au traitement de l’information.

L’article de Rosenblueth, Wiener et Bigelow avait déjà opéré un premier déplacement : il n’y était plus question d’êtres vivants ou non vivants, les deux catégories étaient rassemblées dans un concept unique, celui de système organisé avec un comportement dirigé par un but. L’analogie homme-machine, déjà dotée d’une longue histoire (Cassou-Noguès, 2007), connaît alors un tournant dans le champ scientifique. L’article de Von Neumann opère un second déplacement en passant du calcul au traitement de l’information, sur la base d’une théorie de l’information et de la communication qui décontextualise complètement la notion d’information. Désormais, tout peut être information à condition de passer par les fourches caudines de la digitalisation, c’est à dire d’une mise en code binaire. Il faut noter que von Neumann n’utilise jamais la notion de « traitement de l’information » dans son article mais, comme le rappelle Mathieu Triclot, il s’appuie sur l’autre article fondateur de la cybernétique, celui de McCulloch et Pitts, pour étayer sa démonstration :

Il faut bien avoir conscience que le modèle de McCulloch et Pitts ne joue pas un rôle périphérique dans le rapport. Les neurones formels de McCulloch et Pitts sont utilisés pour ce qui est considéré comme le chef d’oeuvre de von Neumann : la définition de la structure logique de l’ordinateur et la mise au point des circuits de calcul au sein de l’unité arithmétique. (Triclot, 106)

McCulloch et Pitts proposent de « penser » le cerveau comme un centre de traitement de l’information. Nous croyions penser ? Eh ! non, nous disent les auteurs, nous traitons de l’information :

La nouvelle théorie logique de McCulloch et Pitts rend possible de considérer le cerveau comme un organe de traitement de l’information. Cette représentation est mobilisée dans le travail de Von Neumann […], avec un double effet : d’une part l’ordinateur apparaît comme une machine équivalente (nous soulignons) au cerveau […], d’autre part l’idée du cerveau comme un organe logique de traitement de l’information en sort considérablement renforcée. (Triclot, 107)

Tous ces travaux ont été fortement inspirés et rendus possibles par un article de Turing rédigé en 1936, « On Computable Numbers, with an Application to theEntscheidungsproblem ». Turing y présente un concept de machine universelle, la machine de Turing, une machine abstraite, « machine de papier » (Girard, 26), capable d’effectuer n’importe quel calcul si l’on entend par calcul l’application mécanique d’une suite de règles explicites. Von Neumann ne fait aucune référence à cet article mais il est évident qu’il l’a lu avec attention :

Dans le « First Draft of a Report on the EDVAC», l’article [de Turing, de 1936] n’est pas cité, mais le seul texte cité, l’article de McCulloch et Pitts de 1943, joue quasiment le même rôle, dans la mesure où McCulloch et Pitts présentent explicitement leur modèle comme équivalent au modèle de la machine de Turing. (Triclot, 122)

Nous venons de présenter succinctement quelques idées au fondement de la théorie cybernétique, afin d’expliciter l’ambiancescientifique dans laquelle s’inscrit l’article de Turing qui nous intéresse ici. Avant de présenter l’imitation game de Turing, nous aimerions proposer une autre explicitation : celle de l’ambiance littéraire de cette époque marquée par l’avènement de l’idée d’ordinateur.

Le « moment cybernétique » coïncide avec l’âge d’or de la littérature de science-fiction. Bien qu’on puisse faire remonter les origines de ce genre au 19ème siècle avec les œuvres de Jules Verne et au début 20ème siècle avec H. G. Wells, il est évident qu’il se passe quelque chose d’important du côté de la science-fiction entre 1930 et 1960. Le succès des pulps, ces magazines bon marché qui ont inondé les États-Unis à l’époque, a permis une large diffusion de ce nouveau genre. Nous voyons alors émerger les grands romans devenus cultes aujourd’hui : Le meilleur des mondes d’Aldous Huxley (1931), 1984 de George Orwell (1949), Chroniques martiennes de Ray Bradbury (1950), Fondationd’Isaac Asimov (1951), Le temps désarticulé de Philippe K. Dick (1959). Certains de ces auteurs suivent de très près le développement des thèses cybernétiques à partir des années 1950, comme l’a montré Katherine Hayles dans son analyse très précise des thèmes cybernétiques dans des romans de Philipp K. Dick et Bernard Wolfe.

La science-fiction fait entrer dans l’imaginaire culturel commun les idées qui émergent dans le champ scientifique. Mais comme on le sait, traduttore, traditore : la SF ne se contente pas d’être la gazette des nouvelles idées scientifiques, elle manipule ces idées, les travaille, les transforme, les pousse à l’extrême. Par exemple, partant de l’hypothèse scientifique d’une forte continuité entre les humains et leurs machines, Philip K. Dick en vient à imaginer des mondes gouvernés par les machines, des mondes où les ordinateurs seraient doués de conscience, des mondes où la frontière humains/non-humains est de plus en plus floue, voire inexistante.

L’article « Computing Machinery and Intelligence » sort en plein essor de la SF et a, lui aussi, inspiré le grand auteur qu’est Philip K. Dick. Dans Do Androids Dream of Electric Sheep ?, le test que doivent passer les individus suspectés d’être des androïdes est une référence au test que propose Turing dans son article. Bien que le romancier ajoute des éléments fictionnels à ce qu’il nomme le test de Voigt-Kampff, le cœur du dispositif consiste en une série de questions dont les réponses (verbales chez Turing, émotionnelles chez Dick) sont censées offrir un critère de différenciation entre humains et machines. Chez Dick, les androïdes sont confondus grâce à ce test mais ils progressent (cf. l’androïde Rachel, à qui Deckard, le personnage principal, doit poser plus d’une centaine de questions pour arriver à la bonne identification). Dans l’esprit de l’article de Turing, si cette progression atteint un point où la bonne identification n’est plus possible alors il faudrait considérer que les androïdes sont aussi intelligents que les êtres humains.

Le rapport entre l’essor de la SF et cette science des années 1950, qui s’intéresse au fonctionnement de l’esprit et met en place un puissant parallèle entre cerveau et ordinateur, nous paraît primordial pour comprendre le ton des scientifiques de cette époque. Il semble qu’il y ait eu une confusion des genres. Le discours scientifique prend lui-même des airs de roman SF, ce qui rend sa lecture, aujourd’hui, à la fois fascinante et quelque peu « exotique » (nous pensons ici aux essais de Norbert Wiener, à la « Théorie des automates reproducteurs » de Von Neumann mais aussi à l’article « Computing… » de Turing).

L’histoire du fondateur de la cybernétique, Norbert Wiener, est tout à fait intéressante sur cette question du rapport fiction SF/ discours scientifique.

Norbert Wiener lui-même a écrit de la science-fiction. C’est une activité qui lui tenait à cœur. Nous retrouvons dans sa correspondance des références émues à ses nouvelles. Pour la plupart, celles-ci ne seront pas publiées (Cassou-Noguès, 2014, 32) mais il est étonnant de voir qu’un scientifique de son rang, populaire (il est interviewé par le magazine Life du 18 décembre 1950, publie des articles dans les plus grandes revues scientifiques, mais aussi grand public) et reconnu par ses pairs, nourrissait le secret espoir de devenir un grand auteur de SF.

Norbert Wiener a écrit des nouvelles SF, mais ce n’est pas sa seule manière d’assouvir son goût pour la fiction. Il rédigea des ouvrages de vulgarisation sur la cybernétique, qui ont été de véritables succès de librairie, et dans lesquels la fiction avait une grande importance. La présence d’objets fictionnels au sein de son discours scientifique est même une caractéristique des œuvres de Wiener. Dans ses livres (1948, 1950, 1964), il recourt aux métaphores, aux analogies, à la petite histoire exemplaire. Dans un de ses derniers ouvrages God & Golem Inc., il reprendra plusieurs histoires qui lui sont chères pour illustrer ses propos : le conte des Mille et une nuits, « Le pêcheur et le djinn », la nouvelle « The Monkey Paw » de l’écrivain anglais W. W. Jacobs. Le titre même de ce recueil fait référence à une légende tirée de la mythologie juive, celle du Golem du rabbin de Prague, qu’il assume sans complexe allant jusqu’à affirmer que « la machine est l’homologue moderne du Golem du rabbin de Prague » (111). Cette référence est intéressante parce qu’elle donne à voir l’univers fictionnel qui travaille sa science cybernétique et sa vision moniste du rapport homme-machine.

Le Golem est, dans la mythologie juive, une créature d’argile qu’un rabbin rend vivante en lui introduisant un papier dans la bouche sur lequel est écrit le nom ineffable de Dieu. Ce qui nous paraît significatif est que cette histoire de Golem n’est pas une fantaisie de scientifique pour vendre plus de livres, c’est une fiction qui, à l’époque, a hanté les concepteurs d’ordinateurs d’une manière assez déroutante. Le théologien juif Gershom Scholem, dans une allocution donnée en 1965, lors de la présentation du premier ordinateur conçu en Israël, le WEIZAC de Chaim Pekeris, félicite « Johann Von Neumann et Norbert Wiener, qui contribuèrent plus que quiconque à l’entreprise de magie d’où est sorti le Golem moderne » (115). La note de l’éditeur de God & Golem Inc. mérite d’être lue avec attention (112) :

Lorsque le rabbin Scholem apprit que l’Institut Weizmann de Rehovot avait terminé la construction d’un nouvel ordinateur, il fit savoir au père de cet ordinateur, le docteur Haïm Pekeris, que le nom qu’il conviendrait de lui donner était à son avis Golem n°1. Le docteur donna son accord, à condition que Scholem prononce le discours d’inauguration de l’ordinateur et explique pourquoi celui-ci porterait ce nom. Cette allocution a été prononcé le 17 juin 1965 à Rehovot.

Cette note a été rédigée en 1965, soit un an après la publication de God & Golem Inc., elle est une réponse allusive au livre de Wiener. Le titre de cette allocution est « Le Golem de Prague et le Golem de Rehovot », ce dernier étant l’ordinateur présenté. Il nous semble que ces histoires, ces fictions, quand elles se retrouvent au beau milieu d’un propos scientifique, ne sont pas là par hasard. Elles révèlent un univers fictionnel, une trame dans laquelle se situe le discours scientifique. Ce dernier se veut objectif, pur, et voilà qu’en son sein apparaissent des bribes de rêves, de fantastique, d’éléments mythologiques. Ces bribes sont comme des réminiscences, des indices qui pointent vers un imaginaire scientifique peuplé d’êtres magiques : des machines dotées d’âme, des sorciers capables de donner la vie éternelle, des forces mystérieuses et autres énergies sombres… et des humains-sans-corps. Nous reviendrons sur cette dernière fiction plus loin.

Passons maintenant à l’analyse de l’article « Computing… » de Turing. D’abord, notons la grande différence de forme entre cet article et celui de 1936, « On Computable Numbers, with an Application to the Entscheidungsproblem», qui avait tant inspiré les cybernéticiens (Von Neumann, McCulloch, Pitts). Ce dernier fourmillait de calculs, formules logiques, termes mathématiques qui demandent certaines connaissances pour être compris. Un article scientifique en somme. En 1950, Turing publie l’étonnant « Computing Machinery and Intelligence » où il est question d’intelligence et d’ordinateur. Ce qui est surprenant, c’est la façon dont est rédigé cet article : il est compréhensible sans prérequis mathématiques. Il s’ouvre sur une petite fiction et se poursuit sur quelques réflexions concernant les objections possibles à l’idée que les machines puissent penser. L’article est divisé en sept sections. Nous proposons un résumé de chacune d’elle afin de suivre la progression des idées de Turing.

La première section commence par ces mots : « Je propose de considérer la question « Les machines peuvent-elles penser ? » (Turing, 136). On entre tout de suite dans le vif du sujet. La question de la possibilité de penser pour une machine n’est pas un détail dans l’article, ce n’est pas une évocation que les philosophes s’empressent de grossir, c’est le sujet très sérieux de l’article tout aussi sérieux du grand mathématicien. Bien sûr, Turing va complexifier quelque peu cette question beaucoup trop philosophique pour être traitée telle quelle. Pour pouvoir y répondre scientifiquement, il commence par expliquer qu’il faut trouver une nouvelle manière de la poser. En effet, le langage courant des années 1950 ne justifie pas un tel usage du mot « penser » ; ce n’est pas une activité que l’on concède aux machines, aussi sophistiquées soient-elles. Turing ne va pas chercher à savoir ce qu’il se passe dans notre cerveau quand nous pensons, ni chercher une définition substantielle de l’intelligence. Il va se concentrer sur l’observable. Une machine sera « dite » intelligente si elle arrive à tromper un humain et à « passer pour intelligente » à ses yeux. Et comme nous avons tendance à n’accorder ce privilège qu’à nous-mêmes, Turing va tromper notre narcissisme en mettant au point un jeu qui ne permet pas de savoir à qui ou à quoi l’on a à faire : machine ou humain.

Il propose un jeu d’imitation. Il imagine trois personnages : un homme (A), une femme (B) et un interrogateur (C). L’interrogateur doit deviner qui est l’homme et qui est la femme. L’homme (A) doit induire l’interrogateur en erreur et se faire passer pour une femme, la femme (B) doit au contraire bien montrer à l’interrogateur (C) que c’est elle la vraie femme. L’homme, la femme et l’interrogateur « qui peut être de l’un ou l’autre sexe » (135) sont dans des pièces distinctes et communiquent via un « téléimprimeur ». L’interrogateur ne peut que poser des questions et les joueurs y répondre.

C’est la première partie du test, il n’est pas question d’ordinateur pour le moment et le lecteur peut légitimement se demander quel rapport il peut bien y avoir entre ce jeu sur les identités sexuelles et la question de l’intelligence des ordinateurs. Voilà ce vers quoi veut nous mener Turing : « Qu’arrive-t-il si une machine prend la place de A [l’homme imitant une femme] dans le jeu ? L’interrogateur se trompera-t-il aussi souvent que lorsque le jeu se déroule entre un homme et une femme ? »

Dans la deuxième section, Turing se demande si cette « nouvelle question vaut […] la peine d’être examinée » (136). Évidemment, la réponse est positive et le principal atout de cette nouvelle question est de tracer « une ligne assez nette entre les capacités physiques et intellectuelles de l’homme » (136). Il défend la méthode question/réponse parce qu’elle est « adaptée pour introduire presque n’importe quel champ des capacités humaines » qui l’intéressent. Il propose d’ailleurs un « spécimen de questions et de réponses » possibles, sur lequel nous reviendrons.

La troisième section présente ce qu’il entend par le terme « machine » et quelles sont celles qui peuvent prendre part au jeu de l’imitation. Il commence par écarter « les hommes nées de la manière habituelle ». Cela paraît logique puisque Turing voit le cerveau comme une machine : il doit commencer par dire que dans le rôle de l’ordinateur, il ne peut accepter un homme avec son cerveau, sinon le jeu n’aurait plus aucune raison d’être. En fait, il ne retiendra que l’ordinateur comme joueur potentiel de l’imitation game : « l’intérêt actuel pour les « machines pensantes » a été soulevé par un type particulier de machines, habituellement appelé « calculateur électronique », ou « ordinateur » » (139).

Dans la quatrième section, Turing donne une définition des calculateurs numériques : « ces machines sont destinées à mener à bien toutes les opérations qu’un calculateur humain pourrait effectuer » (140). Il expose également la composition de l’ordinateur : mémoire, unité d’exécution et unité de contrôle. Ces trois composants sont comparés aux « composants » du calculateur humain. La mémoire correspond au « papier » dont dispose le calculateur humain (feuilles blanches pour le calcul, livre d’instructions) mais aussi à sa mémoire personnelle qui lui permet de garder des traces des différents pas de calcul effectués. L’unité d’exécution correspond au calculateur en train de faire les différentes opérations individuelles nécessaires au calcul dans son ensemble. L’unité de contrôle, enfin, est la vérification qu’effectue le calculateur de ses propres opérations pour s’assurer qu’il a bien suivi les instructions, les a effectuées dans le bon ordre.

Afin de rendre plus compréhensible le fonctionnement d’un certain type d’instruction dans l’ordinateur, Turing propose, dans cette section, ce qu’il appelle une « analogie domestique » et qui nous paraît fort intéressante. On peut donner des instructions pas à pas à l’ordinateur pour effectuer un calcul mais on peut aussi, et c’est bien plus économe pour la mémoire de ce dernier, lui donner des instructions plus générales sur les instructions elles-mêmes : « Si la position 4 505 contient 0, obéissez ensuite à l’instruction enregistrée en 6 707, sinon continuez directement » (142). Cette façon de faire revient à agir comme la mère d’un enfant qui veut qu’il fasse quelque chose de déterminé :

[S]upposons que la mère de Tommy veuille qu’il passe chez le cordonnier tous les matins en allant à l’école pour voir si ses chaussures sont prêtes ; elle peut le lui redemander tous les matins, ou alors placer une fois pour toutes dans l’entrée une note qu’il verra à son départ pour l’école et qui lui dira de passer chez le cordonnier et aussi de détruire la note à son retour s’il ramène les chaussures. (142)

Nous verrons, dans la prochaine partie de notre discussion, que cette « analogie domestique » ne remplit pas le rôle que lui assigne Turing. Elle est là pour mieux nous faire comprendre le fonctionnement de la machine (celle-ci fonctionnerait comme Tommy) mais il nous semble qu’elle réussit surtout à nous suggérer l’idée que Tommy fonctionne comme une machine.

La cinquième section évoque la différence entre une machine particulière et une machine universelle. La machine universelle est un ordinateur qui disposerait d’une mémoire infinie et d’une très grande vitesse de travail. C’est une machine idéale, abstraite qui peut « imiter n’importe quelle machine discrète » (147). Turing propose une variante de l’imitation game en utilisant ce type de machine : si le jeu se joue entre une machine à états discrets et la machine universelle qui l’imite, « l’interrogateur serait incapable de les distinguer ». Or tout ordinateur est une machine universelle, en un sens (si on augmentait significativement sa capacité de mémoire et sa vitesse d’exécution), donc il doit être possible de construire, un jour, un ordinateur capable de jouer avec succès au jeu de l’imitation.

La sixième section propose l’examen de quelques « [v]ues contradictoires sur la question principale ». Il passe en revue plusieurs objections possibles à l’idée que les machines puissent penser (« L’objection théologique », « L’objection de l’autruche », « L’objection mathématique », « L’argument issu de la conscience », « Les arguments provenants de diverses incapacités », « L’objection de Lady Lovelace », « L’argument de la continuité dans le système nerveux », « L’argument du comportement informalisable » et « L’argument de la perception extra-sensorielle »).

Turing ne manque pas d’humour dans sa façon de lever certaines objections. Pour parer aux arguments théologiques, il invoque la puissance du Seigneur : « ne devrions-nous pas croire qu’Il a la liberté de donner une âme à un éléphant si cela lui semble convenable ? » (150). Et partant, pourquoi pas à une machine ? « L’objection de l’autruche » reflète une vision pertinente de notre psychologie : « Le fait que les machines pensent aurait des conséquences trop terribles. Il vaut mieux croire qu’elles ne peuvent pas le faire » (151). Turing propose à ceux-là de chercher une consolation du côté de la métempsychose, etc. Pour la concision de notre propos, nous n’évoquerons pas chaque objection et sa réfutation (voir 149-66).

Enfin dans la septième et dernière section de l’article, Turing réfléchit à la difficulté qu’il y aurait à « programmer » un ordinateur afin qu’il puisse imiter le comportement d’un humain adulte. Il évoque alors la possibilité de programmer plutôt une machine qui « simule l’esprit de l’enfant » (169). Il faut que cette machine-enfant soit capable d’apprendre, il faudrait l’éduquer pour l’amener à « savoir » ce qu’est l’esprit d’un humain adulte.

Nous proposons à présent une discussion critique de l’article. Tout d’abord, en renégociant les termes de la question initiale « Les machines peuvent-elles penser ? », Turing met en place une série de suppositions qu’il convient d’expliciter et de problématiser. Ensuite nous montrerons que, comme dans l’univers fictionnel, il est possible de relier les personnages et l’intrigue aux éléments biographiques de leur auteur. Enfin, nous essaierons de défendre la thèse selon laquelle l’écriture de l’imitation game est plus proche des codes de la fiction que de l’exercice d’imagination pratiqué par le discours scientifique sous le nom d’expérience de pensée.

Au tout début de son article, Turing explique qu’il faut changer la question « Les machines peuvent-elles penser ? » : « […] je remplacerai la question par une autre, qui lui est étroitement liée et qui est exprimée en des termes relativement non ambigus » (135). Les termes de la nouvelle question sont censés être moins ambigus que ceux de la première… Cela n’est pas certain.

Rappelons la nouvelle question : « Qu’arrive-t-il si une machine prend la place de A [l’homme imitant une femme]dans le jeu [de l’imitation] ? L’interrogateur se trompera-t-il aussi souvent que lorsque le jeu se déroule entre un homme et une femme ? » (136). Il nous semble, au contraire, qu’afin de répondre à une question étonnante mais assez claire, Turing a recours à une transformation qui la rend plus ambiguë… La nouvelle question (ou les nouvelles questions) charrie plus de suppositions que la première.

Elle suppose d’abord qu’on peut différencier un homme d’une femme sur un ensemble de réponses données. Elle suppose également que le sexe de l’interrogateur, quoi qu’il arrive, importe peu. On peut se demander s’il n’y a pas là une forme d’incohérence : si les réponses d’un homme sont « par nature » différentes de celles d’une femme, pourquoi l’appréciation de ces réponses ne dépendrait pas également du sexe de celui qui évalue ? Peut-être qu’un homme peut mieux identifier un autre homme parce qu’il sait bien ce que c’est d’être un homme !

Cette nouvelle question suppose aussi que la pensée est une caractéristique de l’intelligence (la question se pose : être intelligent signifie-t-il forcément penser?). Enfin, elle suppose que cette intelligence, qui prouve la pensée, est exclusivement affaire de performance verbale.

Revenons au jeu de l’imitation. L’interrogateur doit poser des questions aux deux personnes mais sans les voir ou les entendre, il faut qu’il y ait une séparation nette entre le domaine physique (les corps) et le domaine intellectuel (les réponses aux questions, les mots). La question que l’on peut se poser tout de suite, sans connaître la suite du test est la suivante : peut-on différencier un homme d’une femme sur les réponses données à un interrogateur ? Et qu’on le puisse ou non, qu’est-ce que cela signifie ? Performance verbale et réalité incarnée sont-elles deux choses complètement indépendantes l’une de l’autre ? Katherine Hayles, dans How we Became Posthuman, propose une analyse très intéressante de cette partie du test :

En incluant le genre, Turing laissait entendre que la renégociation de la frontière entre humains et machines impliquerait plus que la transformation de la question « qui peut penser ? » en « qu’est-ce qui peut penser ? ». Cela remettrait nécessairement aussi en question d’autres caractéristiques du sujet libéral, parce que s’opère un déplacement crucial de distinction entre le corps en acte [the enacted body], présent dans sa chair devant l’écran de l’ordinateur et le corps représenté [the represented body], produit à travers les marqueurs verbaux et sémiotiques qui le constituent dans un environnement électronique. […] Poser la question du « Qu’est-ce qui peut penser ? » change aussi, inévitablement, dans une boucle réversive, les termes de la question « Qui peut penser ? ». (xiii, notre traduction)

Cette partie de la fiction de Turing est déjà très intéressante parce qu’elle ébranle les conceptions de genre en plaçant les personnages dans un contexte où, instantanément, l’aspect physique, charnel est complètement neutralisé. Encore plus intriguant, écoutons la première question que fait poser Turing à son personnage interrogateur : « A peut-il me dire quelle est la longueur de ses cheveux ? » (135). Alors que les mots sont strictement séparés de leur chair, voilà qu’on demande de décrire le corps ! Nous devinons que si A veut se faire passer pour une femme il aurait tout intérêt à répondre qu’il a les cheveux longs… Charge à l’interrogateur de méditer sur la solidité scientifique incontestable de ce critère de différenciation sexuelle.

Dans cette première partie du test, c’est la performance verbale qui fait la différence. Mais Turing ne semble pas très intéressé par la question de savoir si un homme peut se faire passer pour une femme. Ce qui l’intéresse c’est la capacité à simuler un comportement humain. Il propose dans une deuxième partie du test de remplacer l’homme (A) par un ordinateur. L’ordinateur doit simuler un homme simulant une femme. Si l’ordinateur réussit à tromper l’interrogateur autant de fois que l’homme véritable alors il a un comportement indifférenciable de l’homme. Attendu que seul le comportement observable compte, si l’ordinateur a eu un comportement impossible à distinguer de celui de l’humain sur le plan verbal, alors on peut le dire aussi intelligent que l’humain.

Cette deuxième partie du test étonne par sa complexité. L’ordinateur doit simuler une simulation. Pourquoi ne suffirait-il pas que l’ordinateur se fasse passer pour un être humain ? Il semble que cette question ne puisse trouver de réponse si nous nous contentons d’appréhender le texte de l’imitation game comme un discours strictement scientifique. Il faut entrer dans l’expérience que nous propose Turing comme nous entrons dans un monde fictionnel. Nous en acceptons la part d’irrationalité, nous sommes conscients de nous plonger dans l’imaginaire d’un auteur avec tout ce que cela peut impliquer de références personnelles. Cette redondance de la simulation ne paraît pas compréhensible sans faire appel aux éléments biographiques de son auteur.

Turing était homosexuel dans une société et à une époque où cela était considéré comme un crime puni par la loi. Bien sûr, nous sommes dans les années 1950 et la société est en avance sur la loi, comme souvent. Il n’empêche que Turing vit bel et bien dans une société où la frontière homme/femme est rigide et bien nette. Un homme est attiré par des femmes. Une femme est attirée par des hommes. Point. Cacher son homosexualité et simuler la « normalité » ne devaient pas être chose rare. Et rappelons que l’intelligence dans le test que propose Turing consiste à tromper un juge… Turing ne cachait certes pas son homosexualité, il l’assumait ouvertement. Le problème est qu’il vivait dans une société qui le considérait comme « anormal ». Son statut personnel de scientifique reconnu et talentueux l’aidait à être accepté mais ce n’est pas le cas de bien des homosexuels autour de lui, et cette situation semble le tourmenter.

Le décor fictionnel planté par Turing n’est absolument pas anodin. Il convoque des personnes, des ordinateurs, des écrits (des symboles), des pièces vides, des écrans, un interrogatoire (ou bien un procès ?), un homme et une femme s’affrontant pour gagner, une femme revendiquant son identité, un homme cherchant à prendre sa place, un interrogateur aux allures de juge. Et dans ce monde « à la Turing » où les machines peuvent penser : il n’y a pas de corps qui souffrent, pas de chairs, pas d’odeurs, pas de joues qui rougissent, pas de bouches qui parlent, pas de regards inquiets, pas de larmes, pas de châtiments, pas de mort. Quand on sait la fin brutale qu’a connue Turing, on peut questionner la dimension fantasmatique de ce test.

En 1952, après qu’un de ses ex-amants ait reconnu avoir eu une liaison avec lui, il fut poursuivi pour « indécence » et condamné à la castration chimique. Il finira par se suicider en 1954 en croquant dans une pomme empoisonnée au cyanure. Le fait divers à caractère sexuel ne sert que de prétexte à son arrestation. Turing est surtout suspecté d’espionnage pour le compte des Russes. Il ne peut être ouvertement arrêté pour ce motif puisqu’il est un grand héros de guerre, le seul à avoir réussi à déchiffrer les informations fournies par la machine Enigma. Mais la raison officielle de son arrestation, son homosexualité, est proche de la raison officieuse pour laquelle on le suspecte de trahison, il correspond un peu trop au « profil » du traître : homosexuel et mathématicien (voir Hodges).

Nous avons vu que certains éléments biographiques de Turing semblent entrer en résonance avec l’expérience de pensée qu’il propose. Et nous ne nions absolument pas qu’il s’agit bien d’une expérience de pensée que nous propose Turing. Mais, il nous semble qu’il y a quelque chose de plus dans son texte (et ses intentions). L’expérience de pensée, au sens strict, est « l’invention d’un scénario dans lequel on cherche à voir de manière différente, sous une autre perspective, comment certaines choses se lient entre elles. Une expérience de pensée permet d’inventer d’autres solutions » (Nancy Murzilli). Elle nous permet d’imaginer ce qui pourrait résulter d’une expérience donnée si nous avions les moyens de la réaliser. Mais cet acte d’imagination est soumis à des contraintes : l’expérience imaginée est modelée par la théorie scientifique à laquelle elle donne « chair ». Par exemple, dans la célèbre expérience de pensée proposée par Paul Langevin lors d’une conférence donnée au Congrès international de philosophie, à Bologne, en 1910, il y a bien une théorie de la relativité restreinte qui donne déjà, « sur le papier », les résultats que Langevin extrapole à l’humain. L’illustration qu’il donne des résultats mathématiques produits grâce à la théorie de la relativité restreinte n’est pas arbitraire. Ce n’est pas une question de croyance. Voilà comment Langevin présente son exemple : « Il résulte de ce qui précède (nous soulignons) que ceux-là auront moins vieilli dont le mouvement pendant la séparation aura été le plus éloigné d’être uniforme, qui auront subi le plus d’accélération ». Il est intéressant de noter par ailleurs que la conférence de Langevin est beaucoup moins fantaisiste que ce qui est passé à la postérité : il n’est pas question de « jumeaux », ni de « paradoxe », contrairement à ce qui est présenté dans les livres de vulgarisation actuels (voir à ce sujet l’article très instructif d’Elie During, « Langevin ou le paradoxe introuvable », 2014).

Il y a, nous semble-t-il, une grande différence entre ce que fait Langevin et l’entreprise de Turing dans l’article qui nous intéresse. Turing n’extrapole pas à partir de résultats obtenus « sur le papier » pour mieux nous faire comprendre leur portée. Il écrit, au contraire, une véritable « profession de foi ». Et il le dit explicitement. Le fait que les machines puissent penser est une « croyance » forte chez lui, il tente par cet article de convertir les esprits à cette croyance. Dans l’introduction de la sixième section, celle où il examine différentes objections à l’idée de machine pensante, il expose ses propres vues et utilise quatre fois l’expression « je crois » en trois paragraphes. Il l’utilise d’ailleurs comme un leitmotiv qui vient scander le texte et clarifier les choses. « Je crois qu’il ne sert à rien de dissimuler ses croyances » nous dit-il. C’est un savant certes mais c’est aussi un homme qui croit certaines choses, « non vérifiées », possibles (rappelons que Turing a longtemps cru en la possibilité de la métempsychose. Voir Lassègue). Ce texte est là pour exposer ce qu’il croit, il est un ensemble de « déclamations tendant à produire des croyances » (167). Turing dit cela des premiers paragraphes de la septième section, reconnaissant par là que ce ne sont pas « des arguments convaincants » mais cette affirmation peut s’appliquer, selon nous, à tout l’article.

Au début de l’article, Turing nous disait que le langage des années 1950, son époque, ne permettait pas l’usage du mot « pensée » pour décrire ce que font les machines. Ce que fait Turing, par cet article, consiste justement à mettre en place cet usage, à dépeindre un monde possible où cet usage ne déroute plus. Et afin de mieux parvenir à cette conversion des esprits, afin de « produire des croyances », l’utilisation des codes de la fiction semble être une excellente stratégie. Pourquoi ? Parce que le dispositif fictionnel nous met justement dans cet état de « suspension consentie de l’incrédulité » (willing suspension of disbelief. Coleridge) qui favorise la production de la croyance. Quand nous lisons une fiction, nous ne nous demandons pas si cela vrai ou faux, nous acceptons de croire en cet univers le temps de la lecture. Comme le souligne Schaeffer dans Pourquoi la fiction ? : « Celui qui entre dans un dispositif fictionnel ne va pas s’engager dans un questionnement référentiel au sens logique du terme » (212). Il nous semble que c’est justement l’effet recherché par Turing : « Le lecteur doit accepter comme un fait établi que les ordinateurs peuvent être, et ont été, construits suivant les principes que nous avons décrits, et qu’ils peuvent en fait imiter de très près les actions d’un calculateur humain » (142, nous soulignons). Il dit cela suite à la description du fonctionnement du calculateur numérique. Évidemment, Turing peut se vanter d’en savoir plus que la plupart de ses lecteurs sur le fonctionnement d’un ordinateur. Peut-être que l’acceptation du « fait établi » qu’il exige du lecteur est un prérequis à la compréhension de l’article pour celui qui ne partagerait pas ses connaissances théoriques sur le sujet… Mais cette affirmation vient juste après « l’analogie domestique », dont nous parlions précédemment, et cela pose problème. Le « fait établi » que nous devons accepter, nous lecteurs, ne concerne pas seulement la description du fonctionnement de l’ordinateur. Elle concerne également la deuxième partie de l’affirmation, à savoir le fait que ces machines « peuvent en fait imiter de très près les actions d’un calculateur humain ».

Dans cette analogie, le fait que Turing donne un prénom au petit garçon (Tommy), qu’il évoque une scène « domestique » bien connue de tous parents (répéter mille fois de faire quelque chose à leur enfant) et qu’il crée un parallèle entre ce que fait « maman » (écrire une note) et ce que fait le programmateur (écrire des instructions générales sur les instructions), tout cela concourt à créer une proximité entre le lecteur et le propos de Turing. Une proximité affective comme souvent dans la fiction. Turing recherche cet effet de proximité, il cherche à ce que l’on puisse s’identifier à cette machine qui agit comme Tommy. Et pour cela, il va mécaniser le comportement de Tommy, cela aura pour conséquence d’humaniser un peu la machine. Si nous réfléchissons bien à cette analogie, est-il si certain que Tommy et la machine fasse la même chose ? La machine obéira à coup sûr si elle « passe devant l’instruction », qu’en est-il de Tommy ? Comme tout être humain, Tommy obéira peut-être…Tommy peut également passer devant cette note mille fois sans jamais passer chez le cordonnier (parce qu’il est distrait, parce qu’il préfère jouer avec ses copains, parce qu’il n’ose pas avouer à sa maman qu’il a peur du cordonnier… Mille raisons peuvent non pas expliquer mais nous faire comprendre son comportement).

Quoi qu’il en soit, Turing a réussi le rapprochement dans nos esprits : même si nous réfutons que Tommy fonctionne comme une machine, le simple fait de les comparer traduit ce rapprochement. Katherine Hayles illustre très bien ce procédé :

En suggérant certains types d’expériences, les analogies entre machines intelligentes et humaines construisent l’humain en termes de machine. Même lorsque l’expérience échoue, les conditions de base de la comparaison fonctionnent pour constituer la différence signifiante. Si je dis un poulet n’est pas comme un tracteur, j’ai caractérisé le poulet en termes de tracteur, pas moins que lorsque j’affirme qu’ils se ressemblent. (64, notre traduction)

Examinons un dernier point de l’article, qui nous semble revêtir un caractère fictionnel, afin de mieux mettre en place ce rapprochement homme/machine : la présence de dialogues.

Il y a deux dialogues dans ce texte (Turing, « Computing.. », 137, 154). Ils sont très révélateurs de ce que Turing veut nous suggérer : à lire les réponses possibles de la machine, il nous vient à l’idée qu’ « en fait, c’est un humain comme les autre ! » Et en effet, la machine pensante de Turing semble très sympathique, nous pouvons, sans problème, nous identifier à elle : elle hésite, elle réfléchit, elle se trompe, elle ne se sent pas capable d’écrire de la poésie, elle connaît Dickens et elle sait que « personne n’a envie d’être comparé à un jour d’hiver » (155).

Le caractère fictionnel de cet article nous semble tout entier résider dans ce procédé : la question de départ, « Les machines peuvent-elles penser ? », est un prétexte pour mettre en place un monde possible, fictionnel où les machines peuvent effectivement penser. Et pour donner « chair » à ce monde : images, prénom, références culturelles (Dickens, Picasso), décor (pièces vides, entrée de chez Tommy), sexe, dialogues… Autant d’éléments fictionnels qui permettent l’immersion que requiert l’expérience fictionnelle.

Le but de l’entreprise nous semble clair : participer à l’élaboration d’un monde où les machines peuvent être dites « intelligentes ». Le dispositif fictionnel est une bonne manière de réussir : « Nous aurions […] tort de penser le possible comme s’il possédait une antériorité par rapport au réel ; il ne redouble pas la réalité, il y participe et la construit » (Nancy Murzilli, nous soulignons). C’est ce qu’a fait Turing, peut-être plus que quiconque, avec cet article et ses travaux : il a « construit » notre monde, un monde où smart peut être accolé à phone, un monde où l’intelligence artificielle est un domaine de recherche scientifique légitime et non un exemple d’oxymore.

Turing avait d’ailleurs prédit cet usage contemporain du langage : « [J]e crois qu’à la fin du siècle l’usage, les mots et l’éducation de l’opinion générale auront tant changé que l’on pourra parler de machines pensantes sans s’attendre à être contredit » (149). Certes, nous accolons plus facilement « intelligente » que « pensante » au mot « machine » mais c’est surtout parce qu’aujourd’hui le mot « pensée » est sorti du champ scientifique au profit d’une multitude de « fonctions » cérébrales.

Le jeu de l’imitation nous propulse dans un monde sans corps, tout comme l’était déjà la machine abstraite de 1936, une machine sans support physique. Et c’est cette idée que nous voulions évoquer pour pointer vers la grande fiction qui hante notre imaginaire scientifique actuel : celle de l’humain-sans-corps. Cette dernière prend ses racines bien sûr loin dans l’histoire (on pourrait remonter à Platon) mais cette idée d’humain-sans-corps a vraiment trouvé un large écho scientifique et est devenue un paradigme de pensée de la pensée à partir des années 1945/1950 avec, entre autres, les travaux de Turing et les concepts des scientifiques que nous avons présentés.

Nous aimerions maintenant évoquer le cas du Human Brain Project (HBP), ce grand projet européen de coopération scientifique que la Commission européenne a officiellement désigné, en janvier 2013, comme « FET-Flagship » ou projet-phare. C’est un programme de recherche qui vient d’obtenir un financement sans précédent (un milliard d’euros sur dix ans) dont l’objet est de mieux comprendre le fonctionnement du cerveau et de la pensée humaine en créant un cerveau artificiel simulé par un superordinateur.

Le projet est ambitieux et très sérieux, il est motivé par des besoins médicaux : mieux comprendre l’évolution de certaines maladies du cerveau pour mieux les traiter. Il y a bien évidemment aussi des acteurs plus intéressés en jeu (IBM, l’industrie militaire et pharmaceutique). Les ambitions de ce projet nous semblent complètement se fondre avec la perspective cybernétique. Le communiqué de presse du HBP, publié en ligne le 12/01/2013, est parlant :

Le HBP regroupera les scientifiques de tout le continent autour de l’un des plus grands défis de la science contemporaine : comprendre le cerveau humain.

Le Human Brain Project (HBP) a pour but de réunir toutes les connaissances actuelles sur le cerveau humain afin de le reconstituer, pièce par pièce, dans des modèles et des simulations informatiques. […] La reconnaissance des objets et des actions, la conscience du corps et de soi, la prise de décision, la navigation spatiale sont autant de fonctions qui seront analysées par imagerie cérébrale et reproduites dans des simulations. Une attention particulièrement sera portée à la question, non résolue, du propre à l’espèce humaine (nous soulignons) : langage, symboles, représentation de l’esprit d’autrui, apparition d’aires nouvelles dans le cortex préfrontal.

Le HBP ambitionne de simuler l’action du cerveau par un ordinateur et ainsi de percer le secret de notre humanité. Cela laisse entendre qu’un cerveau qui n’est pas fait de chair et qui n’est pas un des organes constituant un être de chair est quand même un cerveau. C’est une unité qui se suffirait à elle-même. L’humain se définirait par cette unité, plus que par l’entièreté de son corps. Nous ne cherchons pas à dénoncer cette vision dualiste d’un humain d’abord défini par son cerveau. D’ailleurs le corps ne semble être ici que l’enveloppe secondaire, le véhicule accessoire de notre « cervordinateur » selon le néologisme pertinent du philosophe Patrick Juignet. Nous ne tenons ici qu’à rappeler l’histoire du champ scientifique qui sous-tend une telle vision et montrer que la fiction y a joué un rôle crucial. Les « petites » fictions de Norbert Wiener, celle des grands auteurs de science-fiction, les fictions élaborées par les scientifiques eux-mêmes au sein de leurs articles ; toutes ces fictions façonnent nos ambitions, nos croyances, nos désirs. Elles façonnent autant qu’elles sont façonnées par les désirs, croyances et ambitions du scientifique, de l’auteur, de sa société, de son époque et ceux des organismes subventionnaires ! C’est ce double mouvement qu’il nous tient à cœur de rappeler. Force est de constater que les hypothèses scientifiques ont tendance à oublier leurs origines fictionnelles et à prendre pour point de départ impartial ce qui est déjà lourd de sens, ce qui est déjà hanté. Il nous paraît important de comprendre comment la fiction se transforme progressivement en programme de recherche.

Pour conclure, rappelons que des ordinateurs passent ce qui est maladroitement nommé le « test de Turing » depuis deux décennies (1991). Le prix Lœbner, récompensant un logiciel conversationnel capable de tromper un interrogateur quant à son statut de machine, n’a jamais été remporté par qui que ce soit, et ce malgré le fait que le fondateur, Hugh Lœbner, ait été accusé de manque de rigueur scientifique et d’excentricité : cela n’a pas suffit à faire emporter l’imitation game par une quelconque machine. Les ordinateurs dont nous disposons sont pourtant bien plus puissants que ce que Turing avait imaginé. Et si cet échec à simuler un comportement intelligent ne venait pas de la stupidité (ou difficulté ou inadéquation) du test ? Et si cet échec découlait naturellement des conditions d’émergence de cette fiction première qu’élabore Turing ? Katherine Hayles a très bien senti ce point nodal du dispositif fictionnel de Turing (xiv, notre traduction) :

Considérez le test de Turing comme un tour de magie.

Comme tous les bons tours de magie, le test repose sur sa capacité à vous faire accepter des affirmations à un niveau antérieur qui détermineront la manière dont vous interpréterez les choses que vous verrez plus tard. Le moment important n’est pas celui où vous essayez de déterminer qui est l’homme, la femme ou la machine. Le moment important se trouve bien en amont, quand le test vous place dans un circuit cybernétique dans lequel votre volonté, votre désir et votre perception sont entremêlés en un système cognitif distribué dans lequel les corps représentés sont joints aux corps de chair à travers des interfaces machiniques, mutantes et flexibles. Quand vous fixez les signifiants clignotants qui apparaissent sur l’écran de l’ordinateur, qu’importent les identifications que vous donnerez aux corps de chair que vous ne pouvez voir, vous êtes déjà devenus posthumains.

Nous comprenons le terme posthumain dans ce contexte comme l’humain qui se conçoit lui-même comme un nouvel humain, un humain-sans-corps, un être constamment ailleurs. Certes, cette idée est vieille comme le monde, et au moins comme le christianisme, mais il y a une nouveauté : une puissante technologie au service de ce fantasme. Une technologie numérique qui entend faire de ses fictions une réalité et qui comprend la réalité comme une de ses fictions. Ces technologies numériques sont bien plus efficaces, bien plus présentes dans nos vies que ce que l’humanité a connu jusque là. Elles viennent se glisser entre nos corps représentés et nos corps de chair et les redéfinir tous les deux d’une manière neuve. Nous avons essayé de montrer que les différents usages de la fiction dans la science nous révèlent l’imaginaire des scientifiques où s’est opéré un déplacement significatif dans la manière d’appréhender ce qu’est l’humain. La fiction d’un humain-sans-corps, d’un humain réduit à sa seule capacité à manipuler des symboles se met en place pendant ce « moment cybernétique » et nous mène aujourd’hui à une redéfinition profonde de notre identité.

ISSN 1913-536X ÉPISTÉMOCRITIQUE (SubStance Inc.) VOL. XIV

BIBLIOGRAPHIE

ASIMOV Isaac, Fondation [1951], Paris, Gallimard, Rayon Fantastique, 1957.

BRADBURY Ray, The Martian Chronicles, New York, Doubleday, 1950.

BRETON Philippe, L’utopie de la communication. Le mythe du « village planétaire », Paris, La Découverte, 1997.

CASSOU-NOGUÈS Pierre, Les rêves cybernétiques de Norbert Wiener, Paris, Seuil, 2014.

CASSOU-NOGUÈS Pierre, Mon zombie et moi. La philosophie comme fiction, Paris, Seuil, 2010.

CASSOU-NOGUÈS Pierre, Une histoire de machine, de vampires et de fous, Paris, Vrin, 2007.

COLERIDGE Samuel Taylor, Biographia literaria; or biographical sketches of my literary life and opinions, Londres, Rest Fenner, 1817.

CHANGEUX Jean-Pierre, L’Homme neuronal [1983], Paris, Hachette, 2002.

DICK Philip K., Do Androids Dream of Electric Sheep ? New York : Doubleday, 1968.

DICK Philip K., Le temps désarticulé [1959], traduction de Philippe R. Hupp, Paris, Calmann-Lévy, 1975.

DURING Élie, « Langevin ou le paradoxe introuvable », in La Revue de métaphysique et de morale, novembre 2014.

GIRARD Jean-Yves, La machine de Turing, Paris, Seuil, 1995.

HAYLES Katherine, How we Became Posthuman. Virtual Bodies in Cybernetics, Literature, and Informatics, Chicago, The University of Chicago Press, 1999.

HODGES Andrew, Alan Turing, The Enigma, Londres, Burnett Books Ltd., 1983.

HOTTOIS Gilbert, Philosophie et science-fiction, Paris, Vrin, 2000.

HUXLEY Aldous, Le meilleur des mondes [1931], Londres, Chatto & Windus, 1932.

JUIGNET Patrick, « Le cerveau-machine. Critique du computationnisme », Philosciences.com, 2011 [En ligne], URL http://www.philosciences.com/Formel/Cervordinateur.html [Consulté le 26 août 2014].

LANGEVIN Paul, « L’évolution de l’espace et du temps», Revue de métaphysique et de morale, 19 (4), 1911.

LASSÈGUE Jean, Turing, Paris, Les belles lettres, 1998.

McCULLOCH Warren, PITTS Walter, « A Logical Calculus of the Ideas Immanent in Nervous Activity », Bulletin Mathematical Physics, n°5, 1943.

MURZILLI Nancy, La fiction ou l’expérimentation des possibles, [En ligne], URL http://www.fabula.org/effet/interventions/11.php [Consulté le 26 août 2014].

ORWELL George, 1984, Londres, Secker and Warburg, 1949.

SCHAEFFER Jean-Marie, Pourquoi la fiction ? Paris, Seuil, 1999.

SHOLEM Gershom, « Le Golem de Prague et le Golem de Rehovot », publié dans Norbert Wiener, God & Golem Inc., A Comment on Certain Points where Cybernetics Impiges on Religion, Boston, MIT Press, 1964, Nîmes, Editions de l’Éclat, 2000, p. 113-123.

TRICLOT Mathieu, Le moment cybernétique. La constitution de la notion d’information, Seyssel, Éditions Champ Vallon, 2008.

TURING Alan, « On Computable Numbers, with an Application to the Entscheidungsproblem »,in Proceedings of the Mathematical Society, série 2, vol. 42 (1936-1937), p. 230-265.

TURING Alan, « Computing Machinery and Intelligence », Mind, 59, 1950, p. 433-460.

VON NEUMANN John, « First Draft of a Report on the EDVAC », Contract No. W-670-ORD-4926 Between the United States Army Ordnance and the University of Pennsylvania, Moore School of Electrical Engineering, 30 juin 1945.

WIENER Norbert, ROSENBLUETH Arturo, BIGELOW Julian, « Behavior, Purpose and Teleology », in Philosophy of Sciences, t. X, n°1, janvier 1943.

WIENER Norbert, Cybernetics, or control and communication in the Animal and the Machine, Paris, Hermann, New York, John Wiley & Sons, 1948.

WIENER Norbert, The Human Use of Human Beings : Cybernetics and Society, Boston, Houghton Mifflin, 1950.

WIENER Norbert, God & Golem Inc. A Comment on Certain Points where Cybernetics Impiges on Religion, Boston, MIT Press, 1964, Nîmes, Editions de l’Éclat, 2000.

Site du Human Brain Project : https://www.humanbrainproject.eu/ [Consulté le 26 août 2014].

Communiqué de presse du Human Brain Project, [En ligne], URL http://www2.cnrs.fr/presse/communique/2965.htm [Consulté le 26 août 2014].